-

Compteur de contenus

5 263 -

Inscription

-

Dernière visite

-

Jours gagnés

1 -

Last Connexion

Soon available - 42403

Messages posté(e)s par patry

-

-

Le 10/11/2023 à 11:56, Maïcé a dit :Il faut compter un milliard d'années pour une rotation complète de la galaxie... Ca explique pourquoi tu ne vois pas Andromède bouger.

Quand même pas, c'est beaucoup moins, il faut environ 200 à 250 millions d'années pour que la voie lactée fasse un tour complet.

Donc la "vie" sur la terre a vu environ deux rotations (précambrien, -500Ma). Mais à l'échelle humaine (même pour le début de Sapiens Sapiens) ce n'est pas vraiment significatif.

Malgré tout, dans une grosse centaine de million d'années, on "verra" M31 avec 6 mois de différence (le système solaire aura fait 1/2 tour de voie lactée et M31 sera toujours peu ou prou dans une même direction absolue) et M31 sera dans la direction du bulbe galactique. Mais comme M31 se rapproche de la voie lactée, on la verra aussi un peu plus grosse.

Qui sait, on verra peut être alors une autre "grosse" galaxie qui est actuellement cachée par le bulbe de la voie lactée ?

Marc

-

Un mauvais flat ?

Marc

-

Au C8, pellicule inconnue (peut être de la diapo, j'en faisait beaucoup) dans les années 80~90

En 2000, depuis la réunion (c'est cool de voir le scorpion en entier se lever).

En bien sur LA reine incontestable des comète Hale Bopp (30" de pose,, un trépied au 200/2.8 c'est tout).

Numérisé avec un scanner de film (Minolta Dimage)

Marc

-

8

-

-

Il y a 14 heures, bon ciel a dit :si tu as un portable avec un USB trop lent , un DD qui ne possède pas assez de mémoire tampon .

on le voit très facilement avec firecapture avec la mémoire tampon qui passe à zéro

Il me semble infiniment plus facile d'activer la bufferisation dans le logiciel de capture qui va utiliser la ram de l'ordinateur (qui cette fois se compte en Go) plutôt que d'avoir une mémoire de quelque centaines de Mo dans la caméra. Cela permet de compenser un débit de disque dur insuffisant. C'est ce que j'ai fait sur mon ancien PC qui n'avait pas de SSD. L'écriture du fichier se terminant de longues secondes après la fin de la capture mais ce n'est pas un problème, en monochrome on profite de ce "temps" pour changer de filtre et refaire la mise au point.

Par contre avec un USB2 quand il faudrait un USB3 cela pourrait être une solution mais souvent les caméras ne fonctionnent pas très bien quand l'USB n'est pas au niveau.

En CP, cela me semble de toute façon inutile car le débit d'image est tellement lent que ce n'est pas là le problème.

Marc

-

Photosites de 1,45µm, avec un tel rendement, c'est impressionnant.

Effectivement la barlow sur le C11 devient inutile, on a directement le bon échantillonnage !

Marc

-

4

-

-

C'est surtout la "façon" utilisée pour "augmenter" la focale et les impacts que cela peut avoir.

Dans les deux cas un élément (ou plusieurs) divergeant introduit dans le faisceau (convergeant) de l'instrument va rendre le dit faisceau "moins" convergeant => c'est comme si la focale avait augmenté.

Mais avec une barlow, l'élément divergeant va être influencé par la position du foyer. Dit autrement le chiffre x2 (ou n'importe quel autre) ne sera vrai que pour un certain tirage. Donc en fonction des oculaires positionnés (ils ne sont pas tous identiques) le grandissement va être de x1,8 ou peut être de x2,3 au lieu du x2 ! Par contre pour deux oculaires "par-focaux", pour une même barlow, le grandissement sera identique.

La powermate fonctionne différemment et est moins sujette aux variations, mais dans le principe d'usage cela ne change rien. Elle est aussi souvent plus chère car plus complexe (et puis c'est une Télévue).

En photo, on peut vouloir "jouer" avec le tirage et rendre une barlow x2 comme une x3 ou x4, c'est assez facile avec de simples tubes allonge. Avec une Powermate, ce ne sera pas possible.

Marc

-

2

-

1

1

-

-

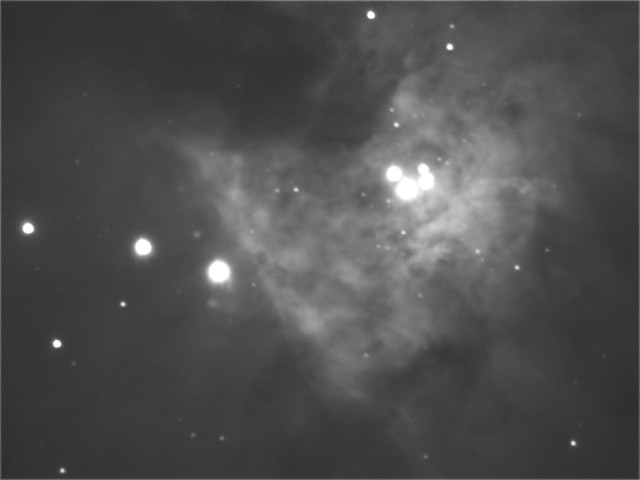

J'ai fouillé dans mon nas, et j'ai trouvé une vieille capture à la DMK21 (pas vraiment une caméra CP on en conviendra) ... avec différentes poses

Les 6 apparaissent clairement sur la pose courte (mais pas les nébulosités), mais dès qu'on allonge le temps de pose, les étoiles les plus faibles disparaissent dans le halo des plus grosses au profit de la nébuleuse. Il faut choisir ce que l'on veut !

Marc

Mea culpa aux spécialistes "CP" ce n'est pas mon truc, du coup je suis à mon maximum là, soyez indulgents !

-

3

-

-

Au C11, c'est (très) facile. Au C8 cela arrive assez souvent.

L'observation est fréquente aussi avec le mak127. A la 80ED on doit y arriver sous de bonnes conditions mais je n'ai jamais tenté l'observation (il faut pas mal grossir pour amener la séparation).

Marc

-

1

-

-

Oui ou dédié planétaire (peu ou prou l'ecliptique donc). Un newton (ou cassegrain) dédié planétaire/solaire de 300mm ca doit déjà bien dépoter !

Par contre monter un tube de XYZ kg accroché par deux QA symétriques, ce doit être un bon moment de stress déjà !

Le C14 de William, quand je l'avais à la maison j'avais trouvé le moyen de monter un établi à la bonne hauteur pour présenter l'instrument à la QA de la NJP pile à la bonne hauteur (sans devoir porter les >20kg de tube en plus), puis une fois le tout fixé, installer les Ctp sur la barre et ... enlever l'établi. Bon ça reste quand même stressant de monter un instrument "lourd" pour le fixer à quelques mm près sur une monture !

Il y a 3 heures, nicephore a dit :Je dirait 50-60 kg.

Mazette, je comprends le trans palette du coup ! C'est indispensable et il n'y a même pas le trépied encore ! Remarque une "chèvre" d'atelier coûte quelques centaines d'euros, et permet de lever/déplacer quelques centaines de kg (en général des moteurs complets ou des transmissions dans des garages) sans effort !

Marc

-

Pour un Newton, la fourche c'est tout sauf pratique. Là elle est "faite" pour un SC, avec une longueur de bras finalement assez réduite. Le tube peut ainsi couvrir tout le ciel même si la zone la plus "délicate" (le pôle) nécessite obligatoirement un renvoi coudé. D'un autre coté, il n'y a pas grand chose à y observer par là !

Un newton dans ce genre de fourche sera fixé très bas et pourrait nécessiter beaucoup de poids coté miroir pour équilibrer l'avant, ce qui n'est pas forcément super pratique ! D'un autre coté, une fois installé en général on a pas besoin de plus de CtP car tout est bien centré sur les axes de la monture.

Après il faut parfois se méfier d'équatorialiser une fourche prévue en alt-az. Les forces de compression peuvent être parfaitement gérées en vertical mais quand on incline les bras ne plus fonctionner du tout (apparition de flexions). Pour sur un LX de 400mm, on est en droit d'être confiant (beaucoup moins pour des petits instruments, et pire encore pour les mono-bras). L'air de rien c'est l'énorme différence que j'ai vu entre le C8 orange de la fin des années 70 que j'avais et le C8 Ultima qui l'a remplacé ; la rigidité est exemplaire sur le second et je n'ai jamais vu apparaître de flexion dans mon utilisation (évidemment je ne charge pas une caméra de plusieurs kg non plus au cul, le plus que j'ai du mettre c'est un Crayford -700gr-, plus un reflex d'un peu moins de 1kg).

Il y a 9 heures, nicephore a dit :Car la roue dentée en AD est gigantesque elle fait 280mm

Je te comprends parfaitement, voilà cette de mon C8 Ultima (un ensemble roue+vsf Byers de presque 200mm) bien faite pour l'astro (359 dents, je vous laisse deviner pourquoi), avec l'entrainement d'un moteur synchrone (110V@60Hz piloté par un variateur de fréquence situé dans la base, avec sa batterie intégrée).

La roue pendant son nettoyage (elle en avait bien besoin) :

http://www.astrosurf.com/patry/Instruments/Pict0671.jpg

Le système d'entrainement avec la VsF mobile sur un pivot à aiguille et un ressort de pression réglable :

http://www.astrosurf.com/patry/Instruments/Pict0520.jpg

En tout cas c'est un beau bestiau cette fourche LX c'est sur ! Le poids de la fourche c'est combien environ ?

Marc

-

1

-

-

Le 03/11/2023 à 20:56, compustar a dit :Personne ne parle du Celestron COMPUSTAR avec sa superbe raquette à la Startrek !!!!

Le problème est la fiabilité de l’électronique (qui ne se fait plus aujourd'hui). Mais l'optique n'en pâtit pas évidemment.

La "bible" est toujours là pour parler de ces instruments : https://skywatch.brainiac.com/used/used_sct.pdf, SCT mais pas uniquement !

Le 04/11/2023 à 10:52, Olivier Meeckers a dit :ont probablement été sélectionnés

Ou plus vraisemblablement bien réglés ! Parce que les "mauvaises" optiques (comprendre au banc optique) sont finalement assez rares ! Il y en a eu (toujours dans une production industrielle selon le curseur mis pour le service qualité) mais les optiques "sphériques" sont infiniment plus simple à faire (même à F2) qu'une parabole à F4 !

Le 04/11/2023 à 11:05, Olivier Meeckers a dit :Les publicités Celestron étaient mémorables avec souvent les mêmes personnages.

Bizarrement, on évoque plus souvent la brune ou la blonde de la pub que Tom Johnson ou Leonard Nimoy. Je crois (dans les années 70~80) que de mettre une pin-up dans les pubs se faisait aussi pour beaucoup d'autres marques.

Marc

-

2

-

-

Il y a 10 heures, Christophe Pellier a dit :j'avais un balcon à lambda/10 à Noisy le Grand

On a été longtemps voisin alors, une grosse vingtaine d'année au plessis trévise (mais j'allais à Noisy prendre le RER pour mes études, puis mon service militaire) avant de déménager à Villejuif, puis le grand saut à Toulouse après 2000 !

Coté livres, outre "Lune Venus & Mars" déjà cité, j'ai toujours le livre des constellations avec toutes ses cartes que j'avais photocopié à une époque "pré-internet" pour l'avoir toujours avec moi !

Marc

-

1

-

-

Il y a 11 heures, den b a dit :J'en ai jamais vu d'autre en France ?

Hooo, un newton a fourche ! C'est beau, (même si je trouve qu'un fourche pour un newton c'est anachronique) et si ce n'est pas bien pensé, ce doit être vite une galère !

Au dela de l'optique et de la motorisation, c'est la mécanique qui est vraiment impressionnante avec l'U8. Parce qu'il y a un "monde" entre la fourche du "orange" et celle du U8, cela n'a plus RIEN à voir. Je ne me hasarderais pas à faire de la photo CP (même de quelques secondes) avec un orange. Pour du planétaire, c'est par contre bien suffisant.

Il y a 10 heures, lyl a dit :Je regardais ce post et je me suis mise à rêver.

Kellner, "H", "R", "HM", "PL" voire "Or", ces oculaires ont bercés mon enfance aussi !

Marc

-

1

-

-

il y a une heure, Olivier Meeckers a dit :ça devait être un solide upgrade au niveau de la stabilité par rapport aux montures à fourche!

Pourquoi ? La fourche de l'U8 n'a rien à envier en stabilité à l'EQ6 (que j'utilise depuis que j'ai cassé une pièce de la déclinaison). On est très loin de la fourche du C8 orange quand même !

il y a 14 minutes, ValereL a dit :Excuse moi, mais de mon côté c'était plutôt une lunette de 60mm de la Redoute.

Pareil, et je l'ai toujours ! Je lui ai trouvé un PO en 31,75mm l'an dernier. Par contre j'ai "perdu" la barre de CTP. J'ai "refait" la chose à partir d'une (grosse) tige fileté. Bon la lunette a été vite complété par un 115/900 avec "presque" la même monture (il y avait la capacité de motorisation). J'ai donné le 115/900 et sa monture à une amie voilà une vingtaine d'année !

Puis, "enfin" le C8 orange.

il y a 16 minutes, rigo35 a dit :la gamme celestron de l 'époque , et une improbable lunette uniton de 75mm refracto-reflecteur

Oui je m'en souviens. Avec les monture "AE", tout en bronze et en laiton/acier. Très très belles pièces mécaniques.

-

3

-

-

En effet

Blague à part, je l'ai remplacé par un Ultima 8 qui est "visiblement" meilleur. Optique très soignée (figure d'airy très propre, transmission bien meilleure, ...) autant que mécaniquement (fourche de qualité +++, roue de 20cm, 359 dents, batterie & variateur de fréquence intégrés, EP très faible ..., par contre pas de goto ou autre joyeuseté informatique) mais il est beaucoup plus lourd ! Le tube sur sa fourche pèse quelques kilogrammes de plus que le C8 orange complet sur son trépied. Et le trépied de l'U8 pourrait largement porter le C11 (c'est pas bien mais je m'en suis servi de marchepied, donc il porte au moins 90kg).

Hormis pour le coté "historique", je ne regrette pas le moins du monde le remplacement du C8 orange quand même !

Marc

-

2

-

-

C'est bon les oranges, c'est plein de vitamines !

C8 "Celestron Pacific" datant d'avant les années 80 (de mémoire depuis son numéro de série).

Marc

-

2

-

1

1

-

-

Il y a 10 heures, Adamckiewicz a dit :Et pas porteur non plus, encore un écueil !

C'est vrai, mais une petite vixen ne pèse pas bien lourd non plus !

Il y a 10 heures, Adamckiewicz a dit :superbes images!

Merci, c'est surtout pour illustrer que le M127 est un super choix. En visuel, il est très proche d'une lunette de 100mm mais le gain en résolution est déjà visible. Et le diamètre de 150 (et encore plus de 180mm) pour les maks devient beaucoup plus important.

Il y a 10 heures, MCJC a dit :Ça y est, je me suis acheté une nexstar 6se. En planétaire, ça devrait être une bonne affaire. La monture devrait le faire.

Solution radicale, mais c'est je pense un excellent choix ! Plus de diamètre (un pouce est un pouce), et surtout plus léger (que le mak) et je pense que la monture dédiée sera aussi bien plus à l'aise pour du planétaire.

Il y a 1 heure, MCJC a dit :La génération de mes parents ne comprends rien au système métrique. Moi, je comprends les deux systèmes mais je suis plus à l'aise avec les livres et les pouces. La génération de ma fille n'a appris que le système métrique.

J'avoue pour ma part que j'ai du mal dans l'autre sens. Je "comprends" les calculs en pouces parce que c'est présent dans notre quotidien (télescopes, écrans plats, ...) passe encore pour les pieds (ok l'avion vole à 33000 pieds, cela me parle aussi). Mais sinon, au quotidien les onces, les gallons, il me faut une calculette pour retranscrire dans le système que je connais. Par contre, gamin, au village de mes grands parents j'allais acheter un "pain de deux" (un pain de 2 livres), qui a perduré jusqu'à la mort ... du boulanger !

Marc

-

1

-

1

1

-

-

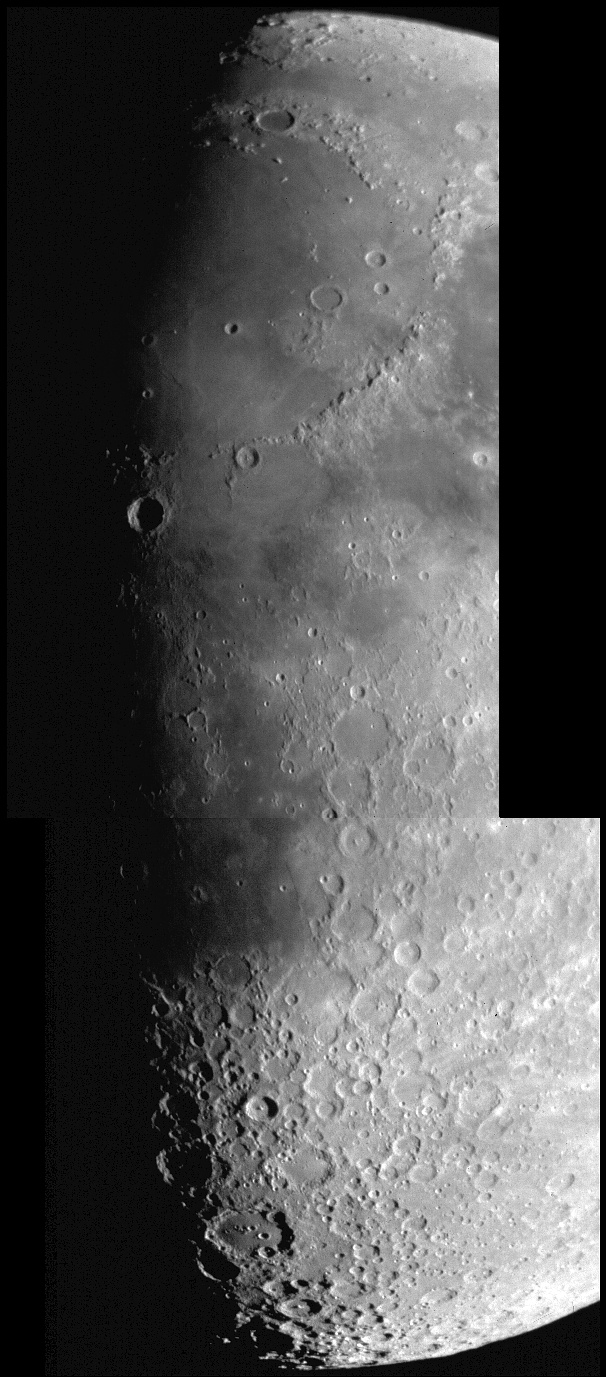

Le mak 127 fait ... 127mm de diamètre et cela commence à bien faire ! En résolution c'est déjà pas mal ... même avec une caméra aussi "basique" qu'une antique Vesta Pro muni toutefois d'un capteur monochrome.

Bien plus récemment, toujours au mak127 avec une ASI462 ...

Donc il ne faut pas se décourager, c'est un très bon instrument ce mak127, mais je crois que la monture est vraiment à reconsidérer. Mais sans aller jusqu'à utiliser une EQ6 (mon cas) il y a certainement de quoi faire avec quelque chose d'autre qu'une Star Adventurer.

Mais comme dit le proverbe, je suis conseilleur, pas payeur !

Mais ne te décourage pas surtout.

Marc

-

1

1

-

-

J'avoue ne pas comprendre le processus.

Si tu veux de la qualité en planétaire il te faut du diamètre et en passant de 127 à 102 l'image sera plus petite, moins résolue (toutes choses égales par ailleurs).

Mais le tube de 102 ne sera pas fondamentalement plus léger que le 127mm et les difficultés de mise au point à priori identiques !

Et je rejoins ce qui à été dit plus haut, la star adventurer est une monture de voyage pour faire de la photo "CP" à courte focale. A priori pas vraiment pour faire de la photo planétaire à 1500 de focale (et plus). Donc mon conseil serait de changer la monture, une vixen SP/GP ou autre EQ3 serait déjà préférable (je ne pratique pas, mais certains y mettent des C8, donc le M127 y serait "à l'aise"). Mais bon, je peux entendre que tu ne souhaite pas changer de monture. Dont Acte.

Autre option, ce serait d'installer un focuseur sur le M127. Sur mon premier j'avais touvé chez ScopeStuff (http://www.scopestuff.com/ss_smsa.htm) une bague de conversion mak/SC et installé un crayford (normalement fait pour le C8/C11). Tu rajoute beaucoup de tirage, plus d'1 kg, mais la douceur de la MAP est sans pareil !

Marc

-

1

-

-

Le 19/10/2023 à 22:51, Bruno- a dit :Tiens, ça me rappelle l'atlas des Pises, une collection de photos prises au Schmidt de l'observatoire des Pises, numérisées, et vendue dans les années 1990 sous forme de CD. Je l'avais acheté mais peu utilisé, et ensuite l'arrivée d'internet faisait perdre l'intérêt de ce genre de collection.

Tiens, je l'ai aussi cet atlas.

Plus tard je leur ai acheté mon U8 (à l'O.P,) pour remplacer mon C8 "Orange". Je l'ai toujours même si le bras de la monture s'est cassé lors d'une préparation de démo pour une école primaire ! Bon j'ai pris une queue d'arronde et j'ai posé le C8 sur l'EQ6, mais je conserve l'idée de réparer la monture, au moins pour avoir une seconde monture et puis j'avoue, j'adore la monture à fourche !

En tout cas, les images CP sont bluffantes et à mon avis, n'on rien à envier qualitativement à ce qui se fait aujourd'hui !

Marc

-

1

1

-

-

Il y a 1 heure, wilexpel a dit :Donc au final tu fais du Bathinov et tu ne retouche plus ta MAP après, pas très compatible avec la HR !

C'est tout à fait cela. Dans un cas la longueur de l'exposition prête le flanc à la turbulence du ciel, et surtout cette qui est lente et souvent longue. Donc c'est le seeing le "mur infranchissable". En planétaire c'est l'instrument qui limite, bon aussi le seeing mais on va travailler tellement vite (quelques ms) que c'est la turbulence haute fréquence qui seule devient gênante. Donc dans la pratique on considère le pouvoir séparateur de l'instrument (quelques dixièmes de seconde d'arc) plutôt que quelques secondes d'arc.

Le corollaire est que l'instrument devient la pièce maîtresse en planétaire, alors qu'en CP, l'instrument a un rôle presque secondaire en regard de la monture (un 150mm fournira souvent des images CP équivalentes à une 80ED à iso monture). Car en planétaire on se "moque" d'avoir une EP de +/- 20" complètement aléatoire, tant que la monture ne présente pas d'harmoniques dans les gammes de fréquence de la capture, c'est tout bon. Mon EQ6 (sous le C11) est mise en station grossièrement vers le pôle, et c'est bien suffisant pour de l'imagerie planétaire. Il faut recadrer +/- souvent voilà tout mais cela n'a aucun impact sur les images produites. Par contre c'est évidemment plus "confortable" de soigner sa mise en station (quand Jupiter ne quitte pas le champ sur 15 à 20 minutes c'est plus cool). Mais cela n'a rien de rédhibitoire, alors qu'en CP ...

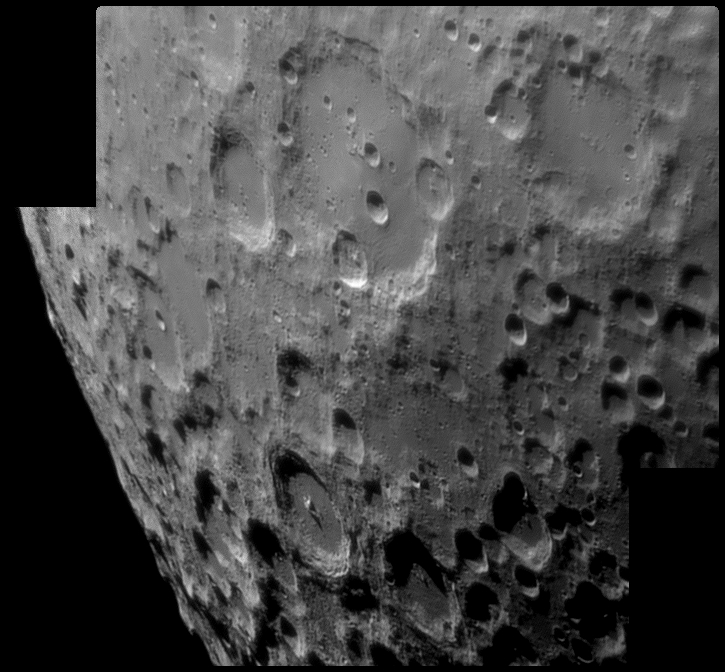

On évoquait la qualité du champ, c'est primordial en lunaire car on "voit" clairement le champ se dégrader sur les bords d'une ASI178 quand je l'utilise en pleine taille. Un SC "Edge" aura un très gros avantage sur ce point. Par contre, vouloir allier HR (largement sous la seconde d'arc) sur un champ très large, c'est TRES compliqué. Peut être qu'un Edge y arrive mais je n'en suis pas trop certain non plus. Et là il faut parler traitement car en planétaire (peut être aussi en CP je n'y connais rien), l'image est découpée en centaines (milliers) de sous-régions qui sont traitées de façon indépendantes. Le logiciel réassemble et corrige (opération de morphing) toutes ces régions en une image à la fin du traitement. Evidemment plus c'est loin (du centre du champ) plus les mouvements peuvent être difficiles à corriger => cela n'aide pas à avoir des bords "propres".

Marc

-

Pourquoi le crop te ferai perdre en qualité ? Tout comme en CP, si tu décide de virer les bords de ton image, ce sont des ciseaux numérique qui vont le faire, sans aucune espèce de perte de qualité sur ce qui n'est pas coupé !

En tout cas, avec des photosites de 4,6µm, et avec une caméra couleur de surcroît, au foyer tu n'atteindra pas la résolution de l'instrument (effectivement pour du planétaire, les calculs de type "CP" ne sont plus d'actualité) ! En CP, titiller une ou deux seconde d'arc c'est déjà un beau challenge (donc la résolution d'une lunette de 60 à 120mm), alors qu'en planétaire on arrive sous la demi-seconde (C11) et certains font beaucoup mieux avec des 400 et des 500mm !

Pour tout dire, avec un rapport F/D un peu supérieur à 20 et en monochrome, on gratte encore un peu en résolution (C11, filtre R+Ir, caméra ASI178). En couleur, malgré tout, tu a une perte sensible de résolution qu'il faut compenser par une focale plus importante.

D'autre part, pour exploiter un capteur aussi "large" (ASI294 couleur, 22mm de diagonale) même un SC Edge aura de la peine (le mak je ne t'en parle pas) si on parle toujours HR ici. Pour moi le capteur est "inutilement" trop gros pour la HR, mais comme j'ai compris que tu avait déjà la caméra alors le crop sera indispensable (tu coupera un peu plus sur un mak et sur un non-edge). Par contre tu gagnera rapidement (toujours dans l'esprit de faire de la HR lunaire) à passer à la caméra monochrome !

Marc

-

1

-

-

Le C8 c'est très bien pour faire "de la lune". Mais il faut un gros capteur pour avoir la lune en entier !

Pour du gros plan, par contre, tu manque de focale. Surtout que tu a souvent envie de grossir plus et plus encore. Du coup, la barlow s'impose naturellement.

Coté formule optique, le mak est très bien, mais il est (très) sensiblement plus lourd qu'un SC => impact monture. Le ménisque est beaucoup plus épais et présente des avantages comme des inconvénients ; son épaisseur retarde la formation de buée (tout cela c'est du vécu) mais à l'inverse, quand la buée est présente, il est difficile de s'en débarrasser (il faut beaucoup de Watts).

Bon tu te pose beaucoup de question et je vais répondre en partie : Pour la mise au point, le SC le fait par translation du primaire et, comme tous les instruments qui font de même, cela PEUT engendrer du tilt (il faut du jeu pour assurer la translation, mais au changement de sens, il y a une bascule => c'est le tilt). Certains fixent le primaire, ce qui peut être une bonne idée si l'instrument est dédié à être utilisé pour un seul domaine (un seul montage optique). La translation du primaire permet de focaliser "à tirage constant", et ton capteur ou ton oeil est "statique" par rapport à l'instrument.La précision de la mise au point, en visuel, peut se contenter du bouton de mise au point, mais pas en imagerie, donc le mieux consiste à translater le capteur cette fois. Donc on utilise les deux systèmes : translation du primaire pour dégrossir, et un second système pour affiner.

Temps de capture ?

Il faut plutôt raisonner en nombre d'images à mon avis. En fonction de la caméra, l'exposition va être de 5 à 10ms (donc 100 images/seconde ou plus), et tu va vouloir en conserver X mais à cause de la turbulence, tu sais que tu ne va en conserver que Y%, donc c'est plus ce calcul que tu va faire.

Type de caméra ?

Pour du lunaire, et en HR, il est préférable d'utiliser une caméra monochrome et disposant d'un champ conséquent. J'ai une ASI178 (monochrome) et une ASI462 (couleur). Franchement, la 462 c'est beaucoup trop petit et quand tu a goûté au champ plus grand, tu n'y revient pas sauf au vouloir faire un truc particulier.

Marc

-

il y a 12 minutes, bricodob300 a dit :Mes prochains cercles seront en PMMA, les graduations gravées au laser et éclairés tangentiellement.

Certains m'ont pris pour un fou quand j'ai fixé quelques leds rouge (sous alimenté) pour éclairer les index de la monture à fourche de mon C8. Car avec un cercle AD de 20cm de diamètre et le vernier qui va avec, je n'avais aucun mal à pointer à moins de 2 à 3' d'angle (et 1 à 2° en dec). Actuellement sur une monture allemande, les cercles sont quand même plus décoratifs qu'autre chose. Je vois qu'on est au moins deux du coup !

Pour en revenir à sevun, je vois qu'on en est à la 9e page de pub, et j'en viens à me dire que je ne suis pas dans le coeur de cible, ce qui doit expliquer pourquoi je n'adhère pas au concept. Mais je souhaite bonne chance aux entrepreneurs et aux futurs valeureux investisseurs. Il en faut pour tout le monde mais ce ne peut pas pour autant être pour tout le monde non plus !

Marc

-

1

-

Galaxie d'Andromède toujours à la même place ???

dans Le coin des débutants

Posté(e)

Rassure toi, je ne suis pas non plus certain de ma valeur (je ne suis pas sorti pour vérifier la vitesse du système terre soleil).

Par contre on trouve une corrélation entre la rotation de la terre (dans la Galaxie) et certains phénomènes physiques et cette période de 200~250Ma se retrouve dans des cycles liés aux grandes extinctions et "pourrait" (avec de grosses guillemets) correspondre à la traversée du système solaire dans des zone de forte densité (les bras spiraux). Et cela ""pourrait"" (cette fois j'ai doublé les guillemets) à cette occasion précipiter des corps externes vers le centre du système solaire comme pour les Dinosaures.

Nota; les 5 extinctions massives (il y a eu d'autres extinctions) sont datés à -445Ma (fin de l'Ordovicien), puis -380Ma (fin du Devonien), -250Ma (fin du Permien), -200Ma (Trias/Jurassique), -65Ma (fin du crétacé), et à part pour la dernière on n'a que des hypothèses pour les autres.

Source : https://fr.wikipedia.org/wiki/Extinction_massive