|

|

|||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||

|

LA TECHNIQUE CCD

|

|||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||

| INTRODUCTION | |||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||

| Cet article est une extension du week end astrophotographie que j'organisais au sein de galileo. Il a pour but de vous donner quelques informations techniques simples vous permettant de débuter en astrophotographie numérique ( CCD ou APN).

Le second titre de cette formation est : comment devenir le meilleur astrophotographe de fra ce en un week end ( LoL) Bonne lecture et surtout bonnes images et beaucoup de plaisir. |

|||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||

| POURQUOI LE NUMERIQUE ET PAS L'ARGENTIQUE | |||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||

|

|

||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||

| M8 argentique 30 minutes de pose avec un télescope de 310 mm de diamètre | |||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||

| M8 numérique 65 minutes de pose ( astrojb) avec une lunette de 101 mm de diamètre | |||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||

| Au vu de ces 2 images ( la première a été prise par un ténor de l'argentique), il n'y a pas photo, c'est le cas de le dire, le numérique est largement plus puissant que l'argentique même très bien maîtrisé. Mais quels sont les aventages du numérique sur l'argentique ? ou demandé autrement : qu'est ce qui fait que tout le monde est passé au numérique ( ou presque)? | |||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||

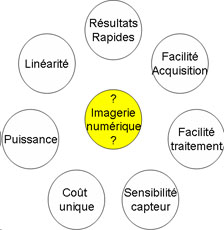

Alors si l'on regarde cette petite roue du numérique on voit plusieeur avantages :

|

|

||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||

|

|||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||

| CHAINE D'ACQUISITION D'UNE IMAGE | |||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||

|

|||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||

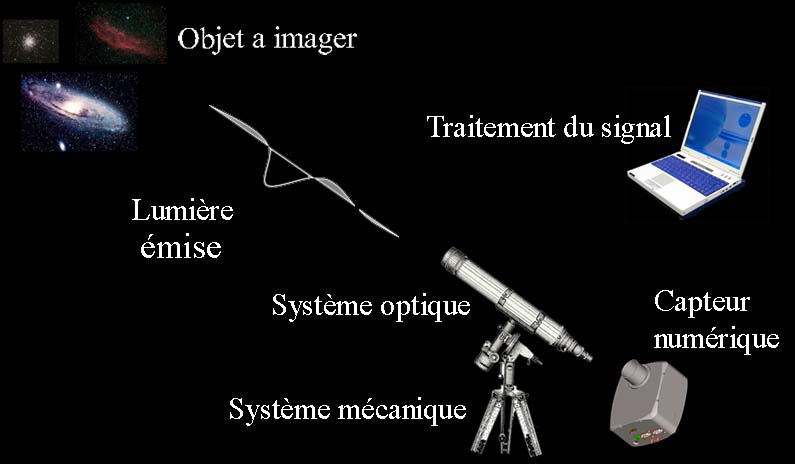

En imagerie, toute la chaîne est importante :

|

|||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||

| LE CAPTEUR NUMERIQUE | |||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||

| Généralités | |||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||

| Quel que soit le capteur utilisé, il possèdent tous une structure unique en 2D que l'on nomme matrice de pixels ( pictures elements).

Par contre deux technologies s'affrontent : CCD et CMOS.CCD signifie Charge Coupled Device et CMOS signifie Complementary Metal Oxyde Semiconductor. Il y a 2 fournisseurs principaux en CCD : Kodak et Sony. Les cpateurs Kodak se partagent la grosse part du marché mais de plus en plus de capteurs Sony équipent les caméras le splus abordables. En imagerie il existe 2 techniques pour avoir la couleur : la monopasse avec un capteur couleur et l'autre.L'autre comme dit utilise un capteur noir et blanc et la couleur est obtenue par l'adjonction de filtres rouge puis vert puis bleu devant le capteur. Après tout ca, nous avons des spécifications barbares : telles les microlentilles, l'antiblooming, le rendement, ... |

|||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||

| Structure | |||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||

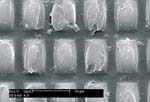

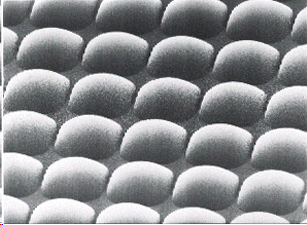

|

Gros plan sur une matrice CCD

Chaque carré représente 1 pixel. 1 pixel = 1 élément photosensible. Les photons ( grains de lumière)qui arrivent sur un pixel sont transformés en électrons ( courant) |

||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||

| Si on regarde le capteur de manière plus macroscopique on se rend compte que le capteur est protégé par une fenêtre. Celle ci évite à la poussière de se déposer sur le capteur ce qui provoquerait des défaillances de celui-ci.

Si on utilise un capteur couleur, une grille rouge, vert, bleu est déposée devant les pixels. On appel cette grille la matrice de bayer ( un calcul informatique permet ainsi d'avoir la couleur en une seule image). Certaine capteurs sont équipés de microlentilles qui permettent de collecter plus de lumière sur le pixel et de rendre ainsi sa sensibilité plus importante. |

|||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||

|

|||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||

|

|||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||

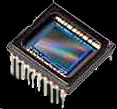

| Quel que soit le capteur, il faut pour aller lire les informations de chaque pixel et l'alimenter. La majorité des pattes transmettent des informations temporelles qui permettent de lire les pixels un à un pour pouvoir reconstruire l'image sur l'écran de l'ordinateur. | |||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||

|

|||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||

| Le CAN !! qu'est ce que c'est ?

C'est un petit composant électronique important.C'est lui qui transforme l'information analogique ( toutes les valeurs possibles) en information numérique. (Convertisseur Analogique Numérique). C'est donc lui qui permet le traitement informatique de l'information. Le numérique ne permet qu'un certain nombre de valeurs, c'est limitant mais la qualité du CAN permet de pallier en partie ce défaut. |

|||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||

|

|||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||

| Vu qu'on parle d'électronique, il y a forcément une crate avec plein de composants. Cette carte permet de piloter le cpateur CCD et de mettre en forme les signaux. | |||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||

| La matrice | |||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||

|

|||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||

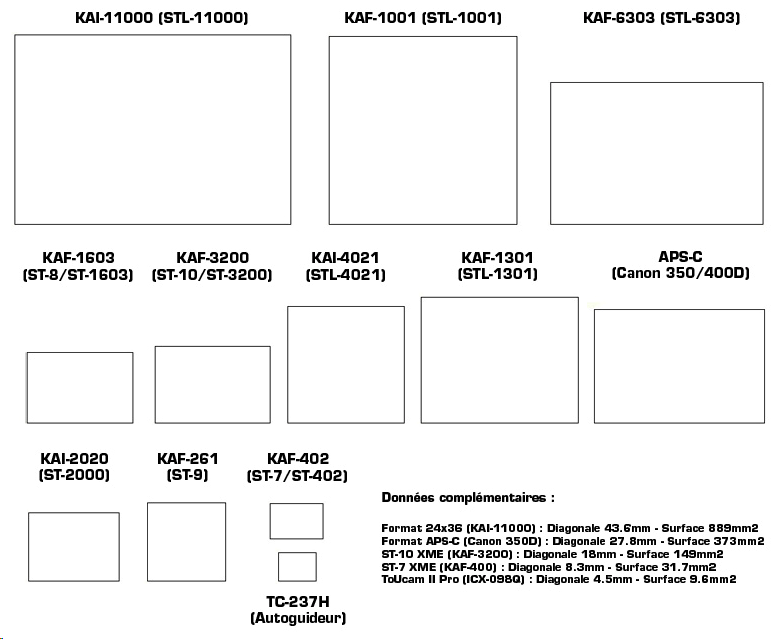

| Les tailles sont extrêmements différentes mais si on y regarde de plus près, la taille des pixels couvre également une très grande gamme.

La taille de la matrice doit être adaptée à l'instrument utilisé :

La taille de la matrice définit la portion de ciel imagée. La taille du pixel doit également être adapté à l'instrument :

La taille du pixel définit l'échantillonage ( la portion de ciel vue par chaque pixel). La taille de la matrice et la taille du pixel donne le nombre de pixels. Plus il y a de pixels plus l'image sera longue a charger et à traiter. |

|||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||

| Technologie CCD et CMOS | |||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||

| Les CCD sont les capteurs des caméras astro, scientifiques et quelques APN et webcams.

Les CMOS sont les capteurs qui équipent la majorité des APN et webcams. |

|||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||

| Quels sont les avantages et inconvénients de chaque technologie pour une utilisation astro : | |||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||

|

|||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||

|

|||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||

| Kodak vs Sony | |||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||

| Kodak équipe majoritairement les marques SBIG, FLI, Artemis, ... et Sony les marques Starlight xpress, Atik, Meade... | |||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||

|

|

||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||

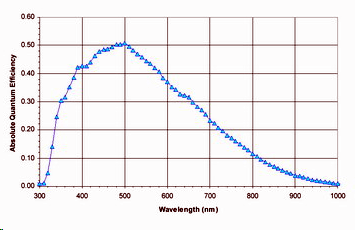

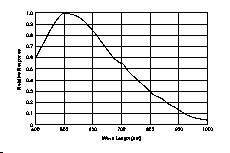

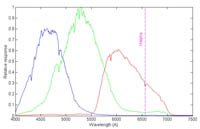

| Réponse spectrale Kodak | Réponse spectrale Sony | ||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||

| Le pic de sensibilité ( Qe, rendement) pour les 2 marques ( capteur standard) sont situés au même endroit. Par contre il faut bien regarder ces 2 courbes, sur celle fournie par Kodak, on a la courbe réeel ave le maximum de la courbe correspondant au rendement du capteur. Sur la courbe fournie par Sony, celle ci est normalisée, sont maximum est à 1. Il fuat donc multiplier cette valeur par le rendement du cpateur pour retrouver la même courbe que Kodak. Sony a un léger avantage sur la sensibiité en Halpha ( 656 nm). | |||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||

|

Globalement les spécifications sont proches, les capteurs Sony ont des pixels plus petits que les capteurs Kodak et le bruit thermique est plus faible sur les capteurs Sony que sur les capteurs Kodak.Kodak a des capteurs plus sensibles ( Qe meilleur) |

|||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||

|

|||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||

| Image d'un dark. On voit bien qu'il y a plein de pixels allumés alors que l'image est fairte dans le noir. C'est le bruit thermique et l'image acquise s'appelle un dark.C'est pour cela que l'on refroidit les capteurs. | |||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||

| Les modes colorimétriques | |||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||

| Ils sont au nombre de 2 : le noir et blanc et la couleur.

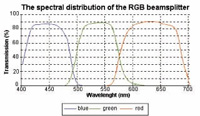

Le capteur numérique ne détecte pas la couleur, il est d'origine un capteur noir et blanc. Pour le passer en "mode couleur", on dispose une matrice rouge-vert-bleu devant le capteur et c'est le traitement informatique qui retraduira la couleur en fonction de la position du pixel et de la couleur associée. L'adjonction d'un telle matrice induit forcément une perte de sensibilité, celle ci est de l'ordre de 30%. De plus cette perte de sensibilité est souvent forte dans le rouge là où les astronomes recherchent beaucoup de signal (raie Halpha). |

|||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||

|

|||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||

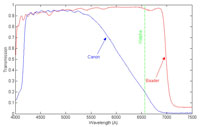

| Ci contre est représenté la réponse spectrale d'un Canon 350D ( bleu) puis un Canon 350D défiltré ( filtre Baader en rouge). | |||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||

|

On place devant chaque pixel un filtre rouge ou vert ou bleu ( réponse spectrale ci contre) suivant un arrangement dit matrice de bayer ( image de droite). Il y a plus de pixels vert que de bleus et de rouges pour avoir une colorimétrie qui ressemble a notre propre vision. | ||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||

|

Le résultat se trouve ci contre. On perd un peu en sensibilité dans le bleu et beaucoup dans le rouge.D'ou des problèmes en imagerie Halpha avec les cpateurs couleurs. De plus chaque pixel a une couleur. Pour recomposer une images on prend par exmple les 4 pixels bleus les plus proches pour reclaculer la valeur bleue d'un pixel vert. Cette interpolation ajoute une perte d'information et de résolution de l'image. | ||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||

| Le CAN | |||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||

| Commenous l'avons vu plus haut, le Convertisseur Analogique Numérique détermine la dynamique de l'image. C'est à dire qu'il détermine le nombre de niveaux sur lequel l'image est codée pour chaque pixel.

Cette dynamique se compte en bits ou ADU ( Analog-to Digital intensity Units). Un peu de pratique maintenant pour maitriser tout ceci : |

|||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||

|

|||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||

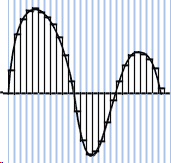

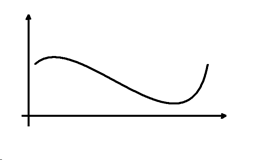

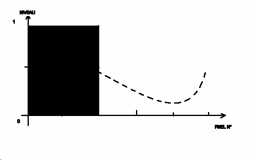

| Prenons d'abord un signal analogique. Celui-ci comprend toutes les valeurs possibles de niveaux. Il n'y a pas de discontinuité dans le signal.

Comme vu plus haut, ce signal n'est pas exploitable par un ordinateur, il faut le numériser et donc le discrétiser. |

|||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||

|

|||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||

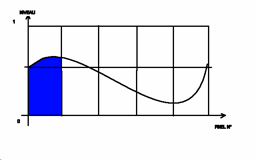

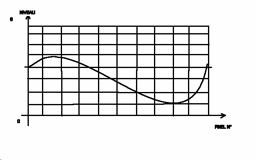

| Disposons les pixels sur l'axe x et en y, numérisons le signal. Celui-ci est numérisé sur 0 et 1 donc 1 bit ( = 2niveaux ).

Pour chaque pixel, nous allons regarder l'aire comprise sous le signal qui est supérieure à la moitié du niveau. L'aire totale est marquée en bleu sur le graphe ci contre. L'aire étant supérieure à la moitié, nous allons asigner la valeur 1 à ce pixel ( en noir sur la courbe suivante ). |

|||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||

|

|||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||

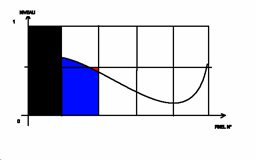

| Prenons le deuxième pixel. Effectuons le calcul de l'aire. et effectuons le même calcul que pour le premier pixel. Ce pixel aura également la valeur 1. Les pixels suivants aurons tous une valeur assignée à 0 ( leur aire est inférieure à la moitié). | |||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||

|

|||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||

| Voilà l'allure du nouveau signal. Ce qui saute aux yeus, c'est la perte d'informations. le codage du signal ne se fait pas sur un nombre siffisant de niveaux ( bits).

Alors refaisons le même calcul mais sur plus de niveaux. |

|||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||

|

|||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||

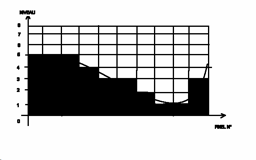

| Voilà le nouveau codage sur 8 niveaux soit entre 0 et 7. Mais combien de bits cela fiat il ?

8 niveaux = 3 bits. Soit 2*2*2= 8 niveaux. Qu'est ce que ça donne comme signal pour notre petit PC adoré ? |

|||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||

|

C'est beaucoup mieux ainsi, la perte de signal est beaucoup moins grande. C'est pourquoi il est important que l'image soit codée sur un nombre de bits le plus grand possible.

On remarque néanmoins que tous les niveaux ne sont pas exploités.C'est ce qu'on appel la dynamique d'une image. Il faut l'exploiter au maximum pour être capable de visualiser les plus faibles niveaux de lumière. |

||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||

| Maintenant un petit tableau pour bien intégrer le nombre de niveaux en fonction du nombre de bits. Comme vous allez le voir, cela va très vite. | |||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||

|

|||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||

| Tout ca c'est bien mais physiquement, il se peut que des valeurs négatives apparaissent lors de la numérisation. Cela engendre des valeurs abérrantes alors, pour corriger toutes ces valeurs, on ajoute automatiquement un certain nombre de niveaux. C'est ce que l'on appel l'offset.

Par contre cela fait que l'on aura jamais de niveaux 0 mais par exemple 200 pour pallier cet abérration. |

|||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||

| Des spécifications barbares | |||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||

La plupart des noms barbares et des spécifications ont déjàété vues. Néanmoins revenus sur quelques une de ces spécifications.

Microlentilles : elles ont pour but d'optimiser le rendement du capteur en lui permettant de collecter plus de lumière. Une petite lentille est déposée devant chaque pixel pour focaliser les photons et leur permettre de venir frapper le pixel. Les microlentilles permettent un gain approximatif de 30% sur le rendement. Antiblooming : c'est un artifice qui consiste a éviter les trainées verticales sur le capteur dues à la saturation des pixels. Shématiquement, il consiste a mettre une barrière sur le côté des pixels pour éviter aux électrons de passer. L'antiblooming provoque une baisse d'environ 25% dru endement. Capteur enhanced : ce sont des capteurs qui sont plus sensibles dans le bleu qu'un cpateur classique. On ajoute en fait des atomes "polluants" dna sles pixels pour les booster dans le bleu. Capteur full frame et interligne : ce sont en fait 2 technologies de lecture de la matrice et donc de fabrictaion. Le capteur full frame transfert la totalité de ses informations vers un capteur "aveugle" lors de la lecture et ce en une seule étape. Le capteur interligne possède des lignes intermédiaiares et la lecture se passe en 2 étapes lignes paires puis impaires. Capacité du pixel ( nombre d'électrons) : C'est le nombre maximal d'électrons que peut contenir chaque pixel. Plus se nombre ets grand, plus vous pourrez poser longtemps sans saturer le capteur. Attention, plus le pixel est petit plus ce nombre aura tendances a être bas. Il faut également le relier a la dynamique pour voir la différence de niveau que l'on est capable de discerner. Courant d'obscurité (electrons/pixel/seconde) : c'est le bruit thermique en électrons qu'émet le capteur a une température donnée. Plus celui ci est faible, mieux c'est. Bruit de lecture ( nombre d'électrons) : c'est le bruit émis par la lecture de l'information du capteur. Plus celui ci est faible, mieux c'est. Gain ( électrons/ADU ) : le gain représent le nombre d'électrons qu'il faut pour passer d'un niveau de gris à un autre. Il est normalement donné à une certaine température. Binning : c'est le fait de grouper les pixels. Pourquoi ? he bien, pour 2 raisons. La première est que si l'on groupe les pixels par 4 ( binning 2*2), on obtiens un pixel de taille 4 fois plus grande et donc 4 fois plus sensible. La deuxième raison est plutôt pour les montages a grandes focales, on peut être sur-échantilloner l'image, le binning permet dans ce cas de diviser l'échantillonage par un facteur 2 dans le cas du binning 2*2. Back focus : c'est un terme anglais qui donne la position du capteur dans la caméra CCD. Il est génaralement compté depuis la sortie T2 de la caméra. |

|||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||

| En résumé : le choix d'un capteur | |||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||

| Les points les plus importants pour choisir une capteur CCD:

Technologie CMOS ou CCD. Si vous optez pour un APN, prenez une valeur sûre : Canon et encore plus sûre le 350D. Si vous optez pour une caméra astronomique, préférez la technologie CCD. Version couleur ou monochrome : Je vous conseil du monochrome car il est plus sensible et mieux résolu. Cependant si vous voulez obte,ir des couleurs facilement, le capteur couleur s'impose. Capteur Sony ou Kodak : a vous de voir. Le sony est plus facile a utilser car il a peu de pixels chauds.Le capteur Kodak vous permet d'accéder aux caméras SBIG qui possèdent le double capteur.Le second capteur permet le guidage. Réponse spectrale et rendement maximal : ils sont donnés par le capteur utilisé. Numérisation : sur combien de bits l'image est codée. C'est important pour faire ressortir les détails au traitement. Version antiblooming, enhanced, microlentilles : a vous de choisir en fonction des objets que vous voulez faire. Refroidissement : c'est important pour avoir le moins de bruit possible. |

|||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||

| Et n'oubliez pas, en astronomie il vous faut plusieurs images pour obtenir une belle image finale.Il faut au minimum 1 image de l'objet a laquelle on va "soustraire" [ une image dark ( le bruit thermique ) + une image offset ( ajout de signal artificiel) + une image de flat ( défauts optiques que nous verrons plus loin)] | |||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||